una funzione analitica. Allora sia la  sia la

sia la  sono funzioni armoniche delle due variabili

sono funzioni armoniche delle due variabili  e

e  :

:

Infatti, è sufficiente calcolare le derivate seconde delle equazioni di Cauchy-Riemann e confrontarle, ricordando che:

Nel caso di funzioni di una variabile reale, spesso la continuità è presentata come una proprietà del grafico: la funzione è continua se il suo grafico è formato da un’unica curva che non compia mai salti. Sebbene questa nozione possa essere usata nei casi più semplici per distinguere funzioni continue da funzioni discontinue, non è formalmente corretta, e può portare ad ambiguità o errori.

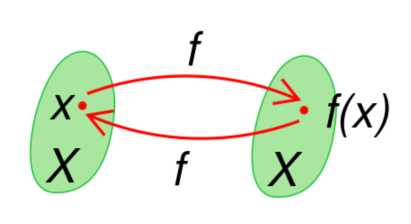

Tale definizione è usata maggiormente per funzioni definite su un intervallo della retta reale: infatti, essa ha senso solo se  è un punto di accumulazione per il dominio di

è un punto di accumulazione per il dominio di  .

.

Essa è comunque estendibile anche nel caso di domini più complicati, che comprendono punti isolati: in essi,  risulta continua per una “verità vuota” (dall’inglese vacuous truth).

risulta continua per una “verità vuota” (dall’inglese vacuous truth).

In generale, l’inverso non è vero: ad esempio, se una funzione continua è somma di due funzioni, non è detto che entrambi gli addendi siano a loro volta funzioni continue. Ad esempio se

Una funzione continua è sempre continua per successioni, mentre, al contrario è possibile dare esempi di funzioni continue per successioni, ma non continue. L’inverso vale solo se il dominio  è uno spazio sequenziale, come lo sono gli spazi primo-numerabili[8] e dunque in particolare gli spazi metrici: in questo caso, quindi, le due definizioni si possono considerare equivalenti.[9]

è uno spazio sequenziale, come lo sono gli spazi primo-numerabili[8] e dunque in particolare gli spazi metrici: in questo caso, quindi, le due definizioni si possono considerare equivalenti.[9]

Queste proprietà non sono estendibili a funzioni a più di una variabile, in quanto nel piano, nello spazio, e generalmente in  quando

quando  non esiste relazione d’ordine, ovvero non è possibile definire una “destra” o una “sinistra”.

non esiste relazione d’ordine, ovvero non è possibile definire una “destra” o una “sinistra”.

Se la prima (o rispettivamente la seconda) proprietà vale in ogni punto del dominio, si dice che la funzione è semicontinua inferiormente (o rispettivamente semicontinua superiormente).

La semicontinuità (sia inferiore che superiore), è una proprietà più debole della continuità: esistono funzioni semicontinue ma non continue. Viceversa, una funzione è continua se e solo se è sia semicontinua inferiormente che semicontinua superiormente.

Continuità separata.

Nel caso di funzioni di più variabili, è possibile definire una condizione più debole di continuità, detta continuità separata: una funzione  è continua separatamente in un punto

è continua separatamente in un punto  rispetto a una delle variabili

rispetto a una delle variabili  se è continua la funzione di una variabile dipendente solo dal parametro

se è continua la funzione di una variabile dipendente solo dal parametro  , lasciando le restanti variabili fissate al valore assunto nel punto in esame.

, lasciando le restanti variabili fissate al valore assunto nel punto in esame.

Equicontinuità.

Geometricamente, il grafico di una funzione pari è simmetrico rispetto all’asse .

Geometricamente, il grafico di una funzione dispari è simmetrico rispetto all’origine degli assi.

Inoltre dato che l’unica funzione pari e dispari è lo spazio delle funzioni pari è in somma diretta con quello delle funzioni dispari.

è la somma di tre monomi.

Le costanti sono anche chiamate “coefficienti” e sono tutte elementi di uno stesso insieme numerico o di un anello.

I polinomi sono oggetti matematici di fondamentale importanza, alla base soprattutto dell’algebra, ma anche dell’analisi e della geometria analitica.

Somme e prodotti di polinomi danno come risultato un nuovo polinomio.

Somma di due polinomiIl grado (degree) della somma (o differenza) di due polinomi è minore o uguale al polinomio di grado maggiore. È sempre uguale al massimo tra i due, quando i due polinomi hanno grado differente:

.

. .

.

Esempi:

- Il grado di

è 3. Si noti che 3 ≤ max(3, 2)

è 3. Si noti che 3 ≤ max(3, 2)

- Il grado di

è 2. Si noti che 2 ≤ max(3, 3)

è 2. Si noti che 2 ≤ max(3, 3)

Prodotto di un polinomio per uno scalareIl grado del prodotto di un polinomio per un numero scalare (diverso da zero) è uguale al grado del polinomio:

.

.

Esempio:

- Il grado di

è 2, che è appunto uguale al grado di

è 2, che è appunto uguale al grado di  .

.

Si noti che questo non è sempre vero per i polinomi definiti su un anello che contiene un divisore di zero. Ad esempio, in  ,

,  , ma

, ma  . L’insieme dei polinomi aventi coefficienti da un dato campo F e grado minore o uguale a n, forma uno spazio vettoriale (questo insieme non è un anello, e non è chiuso, come mostrato in precedenza).

. L’insieme dei polinomi aventi coefficienti da un dato campo F e grado minore o uguale a n, forma uno spazio vettoriale (questo insieme non è un anello, e non è chiuso, come mostrato in precedenza).

Moltiplicazione di due polinomiIl grado del prodotto di due polinomi definiti su un campo -(oggetto in cui sono definite le operazioni di somma e prodotto, con certe proprietà)- oppure su un dominio d’integrità, è pari alla somma dei gradi dei due polinomi:

.

.

Es.:

- Il grado di

è

è  .

.

Si noti che ciò non è sempre vero per i polinomi definiti su un anello arbitrario. Ad esempio, in  ,

,  , ma

, ma  .

.

Composizione di due polinomiIl grado della composizione di due polinomi  e

e  a coefficienti non costanti è uguale al prodotto dei rispettivi gradi:

a coefficienti non costanti è uguale al prodotto dei rispettivi gradi:

.

.

Es.:

- Se

,

,  , allora

, allora  , che ha grado d 6.

, che ha grado d 6.

Si noti che ciò non è sempre vero per i polinomi definiti su un anello arbitrario. Ad esempio, in  ,

,  , ma

, ma  .

.

Grado del polinomio zero

Possiamo affermare correttamente sia che il grado del polinomio zero è indefinito, sia che il grado del polinomio zero può essere definito con un numero negativo (per convenzione −1 o −∞).

Come qualsiasi valore costante, il valore zero può essere considerato come un polinomio (costante), detto polinomio-zero. Questo polinomio non ha termini che non siano nulli, e perciò, propriamente non ha un grado, vale a dire che il suo grado è indefinito.

Le proposizioni precedenti sul grado della somma, prodotto e composizione di polinomi non si applicano se anche uno dei due è un polinomio-zero..

Le formule valgono se si introducono alcune opportune estensioni. È pertanto utile definire il grado di un polinomio-zero, pari a meno infinito, −∞, e introdurre quindi queste regole aritmetiche.

e

I seguenti esempi illustrano come questa estensione soddisfi quelle di somma, prodotto e composizione di due polinomi.:

- Il grado della somma

è 3. Ciò soddisfa il risultato atteso, cioè che

è 3. Ciò soddisfa il risultato atteso, cioè che  .

.

- Il grado della differenza

è

è  . E, infatti, vale che:

. E, infatti, vale che:  .

.

- Il grado del prodotto

è

è  . E, infatti, vale che:

. E, infatti, vale che:  .

.

Polinomi di una sola variabileUn polinomio generico con una sola variabile si può rappresentare con la seguente scrittura:

con  diverso da zero. Con questa scrittura,

diverso da zero. Con questa scrittura,  è il termine noto e

è il termine noto e  è il grado.

è il grado.  si dice coefficiente direttore.

si dice coefficiente direttore.

Un tale polinomio è

- monico, se

,

,

- completo, se tutti gli

sono diversi da zero, per

sono diversi da zero, per  .

.

Radici di un polinomio

Lo stesso argomento in dettaglio:

Radice (matematica).

Una radice di un polinomio  in una sola variabile è un numero

in una sola variabile è un numero  tale che

tale che

cioè tale che, sostituito a  , rende nulla l’espressione. Quindi se

, rende nulla l’espressione. Quindi se

il numero  è radice se

è radice se

Nel caso di polinomi a coefficienti reali l’insieme delle radici reali di un polinomio  si può visualizzare sul piano cartesiano come l’intersezione del grafico della funzione polinomiale

si può visualizzare sul piano cartesiano come l’intersezione del grafico della funzione polinomiale  con l’asse delle ascisse.

con l’asse delle ascisse.

In un dominio, un polinomio di grado  può avere al più

può avere al più  radici distinte. Esistono polinomi senza radici reali, come ad esempio

radici distinte. Esistono polinomi senza radici reali, come ad esempio

poiché  per ogni

per ogni  reale. D’altra parte, per il teorema fondamentale dell’algebra ogni polinomio complesso ha esattamente

reale. D’altra parte, per il teorema fondamentale dell’algebra ogni polinomio complesso ha esattamente  radici complesse, contate con molteplicità.

radici complesse, contate con molteplicità.

Nella scuola vengono insegnate formule per trovare le radici dei polinomi di primo e secondo grado. Esistono formule analoghe per esprimere la radici di un polinomio di terzo e quarto grado in termini dei coefficienti, utilizzando solamente le quattro operazioni ed estrazioni di radice (la cosiddetta risoluzione per radicali). È stato invece dimostrato nella teoria di Galois che non esiste una formula generale di questo tipo per polinomi dal quinto grado in su.

°°°°°

Funzioni polinomiali

Sia  un anello. A un polinomio

un anello. A un polinomio

-

a coefficienti in  si può associare una funzione polinomiale, che è la funzione da

si può associare una funzione polinomiale, che è la funzione da  in sé definita da

in sé definita da

-

per  . Se

. Se  è finito, allora polinomi diversi possono dare luogo alla stessa funzione. Per esempio se

è finito, allora polinomi diversi possono dare luogo alla stessa funzione. Per esempio se  è il campo con un numero primo

è il campo con un numero primo  di elementi, allora al polinomio nullo e al polinomio

di elementi, allora al polinomio nullo e al polinomio  è comunque associata, per il piccolo teorema di Fermat, la funzione che manda ogni elemento di

è comunque associata, per il piccolo teorema di Fermat, la funzione che manda ogni elemento di  in zero. Lo stesso può valere se

in zero. Lo stesso può valere se  è infinito, ma non è un dominio, per esempio se

è infinito, ma non è un dominio, per esempio se  è un’algebra esterna infinita, in cui vale

è un’algebra esterna infinita, in cui vale  per ogni

per ogni  .

.

Se invece  è un dominio infinito, allora vale il seguente principio d’identità dei polinomi, che afferma che a polinomi diversi sono associate funzioni polinomiali diverse (cioè la funzione sopra descritta che associa a un polinomio una funzione polinomiale è iniettiva):

è un dominio infinito, allora vale il seguente principio d’identità dei polinomi, che afferma che a polinomi diversi sono associate funzioni polinomiali diverse (cioè la funzione sopra descritta che associa a un polinomio una funzione polinomiale è iniettiva):

-

due polinomi  e

e  a coefficienti in un dominio

a coefficienti in un dominio  infinito tali che

infinito tali che  per ogni

per ogni  sono uguali.

sono uguali.

Questo dipende dal fatto che in un dominio un polinomio non nullo ha solo un numero finito di radici.

Negli esempi che seguono, fissiamo  eguale al campo dei numeri reali. A seconda del grado,

eguale al campo dei numeri reali. A seconda del grado,

- un polinomio di grado

è una funzione costante,

è una funzione costante,

- un polinomio di grado

è una funzione lineare,

è una funzione lineare,

- un polinomio di grado

è una funzione quadratica o conica,

è una funzione quadratica o conica,

- un polinomio di grado

è una funzione cubica.

è una funzione cubica.

Esempi

Polinomio di grado 2:

f(x) = x2 – x – 2

= (x+1)(x-2)

|

Polinomio di grado 3:

f(x) = x3/5 + 4x2/5 – 7x/5 – 2

= 1/5 (x+5)(x+1)(x-2)

|

Polinomio di grado 4:

f(x) = 1/14 (x+4)(x+1)(x-1)(x-3) + 0.5

|

Polinomio di grado 5:

f(x) = 1/20 (x+4)(x+2)(x+1)(x-1)(x-3) + 2

|

DerivataUna funzione polinomiale a coefficienti reali

è derivabile e la sua derivata è ancora un polinomio,

Ragionando quindi induttivamente, si può quindi affermare che le funzioni polinomiali sono infinitamente derivabili (o lisce) e che la derivata (n+1)-esima di un polinomio di grado  è la funzione nulla. In realtà esse sono anche funzioni analitiche.

è la funzione nulla. In realtà esse sono anche funzioni analitiche.

°°°°°

Anello di polinomi

Lo stesso argomento in dettaglio:

Anello dei polinomi.

Dato un anello  , il simbolo

, il simbolo

![A[x_{1},\ldots ,x_{n}]](https://wikimedia.org/api/rest_v1/media/math/render/svg/9878551d3c43d5d887ee0230a5eb2ab1abe2bcfe)

denota l’insieme di tutti i polinomi nelle variabili  con coefficienti in

con coefficienti in  . Ad esempio,

. Ad esempio,  può essere un campo come quello dei numeri reali o complessi.

può essere un campo come quello dei numeri reali o complessi.

L’insieme ![A[x_{1},\ldots ,x_{n}]](https://wikimedia.org/api/rest_v1/media/math/render/svg/9878551d3c43d5d887ee0230a5eb2ab1abe2bcfe) risulta essere anch’esso un anello, l’anello dei polinomi in

risulta essere anch’esso un anello, l’anello dei polinomi in  variabili con coefficienti in

variabili con coefficienti in  . Lo studio delle proprietà di questo anello è una parte importante dell’algebra e della geometria algebrica.

. Lo studio delle proprietà di questo anello è una parte importante dell’algebra e della geometria algebrica.

Se  è un campo, l’anello dei polinomi è un’algebra su

è un campo, l’anello dei polinomi è un’algebra su  , e quando

, e quando  è anche un anello euclideo, nel senso che i polinomi possono essere divisi con quoziente e resto come i numeri interi (se

è anche un anello euclideo, nel senso che i polinomi possono essere divisi con quoziente e resto come i numeri interi (se  questo non è vero poiché l’anello di polinomi non è un dominio ad ideali principali).

questo non è vero poiché l’anello di polinomi non è un dominio ad ideali principali).

Esempi

![\mathbb {Z} [x]](https://wikimedia.org/api/rest_v1/media/math/render/svg/0d4da3ac703cc7721ebba91a53f6752de7157124) non è un dominio ad ideali principali, e quindi neanche un anello euclideo. Infatti l’ideale

non è un dominio ad ideali principali, e quindi neanche un anello euclideo. Infatti l’ideale  generato dai polinomi

generato dai polinomi  e

e  non è principale.

non è principale.![\mathbb {R} [x,y]](https://wikimedia.org/api/rest_v1/media/math/render/svg/de78aea249c4a765d912587db125dfdbacc3d432) non è un dominio ad ideali principali, e quindi neanche un anello euclideo. Infatti l’ideale

non è un dominio ad ideali principali, e quindi neanche un anello euclideo. Infatti l’ideale  generato dai polinomi

generato dai polinomi  e

e  non è principale.

non è principale.![K[x]](https://wikimedia.org/api/rest_v1/media/math/render/svg/8a9e6c2ac2830d6a9abe078b47450777c41d69a9) , se

, se  è un campo, è un dominio euclideo.

è un campo, è un dominio euclideo.- Il principio di identità dei polinomi vale solo su domini infiniti. Ad esempio, se

è il campo finito con due elementi, cioè

è il campo finito con due elementi, cioè

-

- allora il polinomio

- è tale che

per ogni

per ogni  in (cioè

in (cioè  e

e  ), benché non sia il polinomio nullo.

), benché non sia il polinomio nullo.

Derivata formale

Lo stesso argomento in dettaglio:

Algebra differenziale.

Il calcolo della derivata di un polinomio si estende come definizione di derivata (chiamata derivata formale) nel caso in cui il polinomio abbia coefficienti in un anello  , anche in assenza del calcolo infinitesimale. Molte delle proprietà della derivata si estendono anche alla derivata formale.

, anche in assenza del calcolo infinitesimale. Molte delle proprietà della derivata si estendono anche alla derivata formale.

Funzione razionale

In matematica, una funzione razionale è una funzione esprimibile come rapporto fra polinomi, in modo analogo ad un numero razionale che è un numero esprimibile come rapporto fra interi.

Definizione

Funzione razionale y = (x²-3x-2)/(x²-4)

Una funzione razionale in una variabile è una funzione del tipo:

dove  e

e  sono due polinomi.

sono due polinomi.

Ad esempio:

è una funzione razionale a una variabile.

Una funzione è detta razionale intera quando al secondo membro figura un polinomio.

Per ottenere il valore della variabile dipendente  , si svolgono operazioni costituite da somme, differenze e prodotti. Alla

, si svolgono operazioni costituite da somme, differenze e prodotti. Alla  può quindi essere assegnato qualsiasi valore.

può quindi essere assegnato qualsiasi valore.

Una funzione è detta razionale fratta quando al secondo membro figura una frazione il cui numeratore e denominatore sono polinomi. In questo caso, per ottenere il valore della variabile dipendente  , oltre alle operazioni costituite da somme, differenze e prodotti, occorre eseguire l’operazione di divisione. Alla

, oltre alle operazioni costituite da somme, differenze e prodotti, occorre eseguire l’operazione di divisione. Alla  può quindi essere assegnato qualsiasi valore che non annulli il denominatore.

può quindi essere assegnato qualsiasi valore che non annulli il denominatore.

Una funzione razionale può essere reale o complessa, a seconda che i coefficienti dei polinomi siano numeri reali o complessi. Più in generale, i coefficienti devono essere elementi di un campo  (che può essere appunto

(che può essere appunto  oppure

oppure  ).

).

Il dominio (anzi, più precisamente l’insieme di definizione) della funzione è l’insieme di tutti i valori  di

di  che non sono radici di

che non sono radici di  . Ovvero, tutti gli

. Ovvero, tutti gli  tali che il denominatore

tali che il denominatore  è diverso da zero. Infatti solo per questi valori ha senso dividere

è diverso da zero. Infatti solo per questi valori ha senso dividere  per

per  .

.

Ad esempio, la funzione razionale descritta sopra, se considerata sui numeri reali, è definita su tutto  meno il punto

meno il punto  . Se considerata sui numeri complessi, è definita su tutto

. Se considerata sui numeri complessi, è definita su tutto  meno le tre radici cubiche dell’unità

meno le tre radici cubiche dell’unità

-

Per comodità, nella discussione che segue si suppone che i polinomi  e

e  non abbiano radici in comune.

non abbiano radici in comune.

Una funzione è irrazionale quando la variabile indipendente  figura sotto segno di radice:

figura sotto segno di radice:

-

se l’indice è pari il radicando deve essere positivo o nullo: il dominio è costituito da tutti i numeri reali diversi da quelli che rendono il radicando negativo;

-

se l’indice è dispari il radicando può essere anche negativo: il dominio è costituito dall’insieme dei numeri reali.

L’espressione “funzione razionale” è anche usata per descrivere un rapporto fra polinomi con più variabili, come ad esempio:

-

Come sopra, la funzione è definita su tutti i punti di  (dove

(dove  è il numero di variabili) per cui il denominatore non si annulla. Tale insieme non è però generalmente un numero finito di punti: si tratta di una più generale varietà affine.

è il numero di variabili) per cui il denominatore non si annulla. Tale insieme non è però generalmente un numero finito di punti: si tratta di una più generale varietà affine.

Asintoti

La funzione razionale

ha due asintoti verticali ed uno obliquo.

Se considerata sui numeri reali, una funzione razionale può avere asintoti, che possono essere agevolmente individuati nel modo seguente.

-

Asintoti orizzontali: sono presenti se e solo se il grado di  è maggiore o uguale al grado di

è maggiore o uguale al grado di  . Se hanno lo stesso grado l’asintoto orizzontale è la retta

. Se hanno lo stesso grado l’asintoto orizzontale è la retta  , dove

, dove  è uguale al rapporto tra il coefficiente del termine di grado massimo di

è uguale al rapporto tra il coefficiente del termine di grado massimo di  e il coefficiente del termine di grado massimo di

e il coefficiente del termine di grado massimo di  , altrimenti l’asintoto è la retta

, altrimenti l’asintoto è la retta  . Questo è infatti il limite della funzione per

. Questo è infatti il limite della funzione per  . Quando il grado di

. Quando il grado di  è maggiore del grado di

è maggiore del grado di  il limite è infinito.

il limite è infinito.

-

Asintoti obliqui: sono presenti se e solo se il grado di  è pari a quello di

è pari a quello di  più uno. Il coefficiente angolare dell’asintoto è pari al rapporto fra i coefficienti dei termini di grado massimo dei due polinomi.

più uno. Il coefficiente angolare dell’asintoto è pari al rapporto fra i coefficienti dei termini di grado massimo dei due polinomi.

Poli

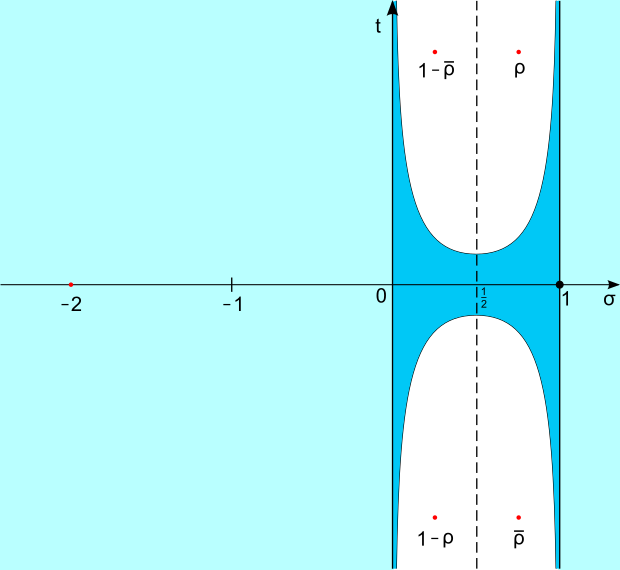

Se considerata sui numeri complessi, una funzione razionale presenta un polo su ogni radice di  , di ordine pari all’ordine della radice. Una funzione razionale è quindi una particolare funzione meromorfa

, di ordine pari all’ordine della radice. Una funzione razionale è quindi una particolare funzione meromorfa  definita sulla sfera di Riemann

definita sulla sfera di Riemann  . Tra queste, le trasformazioni di Möbius:

. Tra queste, le trasformazioni di Möbius:

-

Decomposizione in fratti semplici

La decomposizione in fratti semplici di una funzione razionale è la scrittura della frazione tramite un polinomio (che può essere nullo) sommato ad una o più frazioni con un denominatore più semplice.

Tale metodo fornisce un algoritmo che consente di valutare le primitive di una funzione razionale.

Per illustrare l’idea del procedimento, sia data una funzione razionale  , in cui

, in cui  e

e  sono polinomi, e si consideri la fattorizzazione :

sono polinomi, e si consideri la fattorizzazione : del denominatore.

del denominatore.

Per ogni fattore che ha la forma : si considerano le frazioni

si considerano le frazioni  , mentre per ogni fattore che ha la forma :

, mentre per ogni fattore che ha la forma : si considerano le frazioni:

si considerano le frazioni:

Si ottiene così la scrittura:

e calcolando i coefficienti  e

e  si trova una decomposizione che consente, analizzandone ogni singolo termine, di integrare la frazione di partenza.

si trova una decomposizione che consente, analizzandone ogni singolo termine, di integrare la frazione di partenza.

Essa conduce quindi  ad un’espressione del tipo:

ad un’espressione del tipo:

-

dove  e

e  sono polinomi di grado inferiore rispetto a

sono polinomi di grado inferiore rispetto a  e

e  .

.

Se si applica la decomposizione fin dove è possibile si ottiene che il denominatore di ogni termine è una potenza di un polinomio non fattorizzabile e il numeratore è un polinomio di grado inferiore di quello del polinomio non fattorizzabile.°°°°°Funzione differenziabile

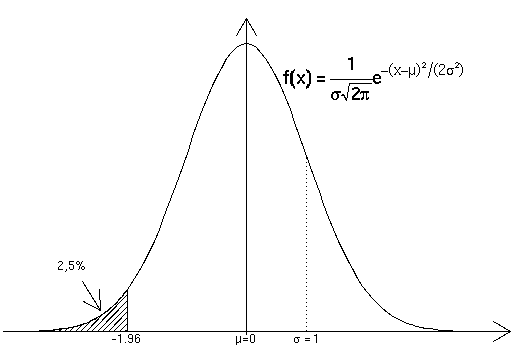

In matematica, in particolare in analisi matematica e geometria differenziale, una funzione differenziabile in un punto è una funzione che può essere approssimata a meno di un resto infinitesimo da una trasformazione lineare in un intorno abbastanza piccolo di quel punto. Affinché ciò si verifichi è necessario che tutte le derivate parziali calcolate nel punto esistano, cioè se è differenziabile allora è derivabile nel punto poiché esistono e sono finiti i limiti dei rapporti incrementali direzionali. Il concetto di differenziabilità permette di generalizzare il concetto di funzione derivabile a funzioni vettoriali di variabile vettoriale, e la differenziabilità di una funzione permette di individuare per ogni punto del suo grafico un iperpiano tangente.Una funzione può essere differenziabile  volte, e si parla in questo caso di funzione di classe

volte, e si parla in questo caso di funzione di classe  . Una funzione differenziabile infinite volte è inoltre detta liscia. Nell’analisi funzionale le distinzioni fra le varie classi

. Una funzione differenziabile infinite volte è inoltre detta liscia. Nell’analisi funzionale le distinzioni fra le varie classi  sono molto importanti, mentre in altri settori della matematica queste differenze sono meno tenute in considerazione, e spesso si usa impropriamente il termine “funzione differenziabile” per definire una funzione liscia.Definizione

sono molto importanti, mentre in altri settori della matematica queste differenze sono meno tenute in considerazione, e spesso si usa impropriamente il termine “funzione differenziabile” per definire una funzione liscia.Definizione

Una funzione da

in

è

derivabile in un punto se è approssimabile vicino a quel punto da una retta. Tale retta deve quindi essere tangente al

grafico della funzione. Questa nozione si estende in dimensioni arbitrarie, e prende il nome di

funzione differenziabile.

Una funzione:

definita su un insieme aperto dello spazio euclideo  è detta differenziabile in un punto

è detta differenziabile in un punto  del dominio se esiste una applicazione lineare:

del dominio se esiste una applicazione lineare:

tale che valga l’approssimazione:

dove  si annulla, con ordine di infinitesimo maggiore di 1, all’annullarsi dell’incremento

si annulla, con ordine di infinitesimo maggiore di 1, all’annullarsi dell’incremento  . Tale condizione si può scrivere in modo equivalente:

. Tale condizione si può scrivere in modo equivalente:

Se la funzione  è differenziabile in

è differenziabile in  , l’applicazione

, l’applicazione  è rappresentata dalla matrice jacobiana

è rappresentata dalla matrice jacobiana  .Il vettore:

.Il vettore:

si chiama differenziale (esatto) di  in

in  ed

ed  viene detto derivata o anche derivata totale della funzione

viene detto derivata o anche derivata totale della funzione  .La funzione

.La funzione  è infine differenziabile se lo è in ogni punto del dominio.[2] In particolare, il teorema del differenziale totale afferma che una funzione è differenziabile in un punto se tutte le derivate parziali esistono in un intorno del punto per ogni componente della funzione e se sono inoltre funzioni continue. Se inoltre l’applicazione che associa

è infine differenziabile se lo è in ogni punto del dominio.[2] In particolare, il teorema del differenziale totale afferma che una funzione è differenziabile in un punto se tutte le derivate parziali esistono in un intorno del punto per ogni componente della funzione e se sono inoltre funzioni continue. Se inoltre l’applicazione che associa  a

a  è continua, la funzione si dice differenziabile con continuità.Nel caso di una funzione

è continua, la funzione si dice differenziabile con continuità.Nel caso di una funzione  di una variabile definita su un intervallo aperto dell’asse reale, essa è detta differenziabile in

di una variabile definita su un intervallo aperto dell’asse reale, essa è detta differenziabile in  se esiste un’applicazione lineare

se esiste un’applicazione lineare  tale che:

tale che:

ed in tal caso si ha:

- °°°°°

Matrice jacobianaSe una funzione è differenziabile in un punto allora tutte le derivate parziali calcolate nel punto esistono, ma non vale il viceversa. Tuttavia, se tutte le derivate parziali esistono e sono continue in un intorno del punto allora la funzione è differenziabile nel punto, ovvero è di classe  .Dette

.Dette  e

e  le basi canoniche di

le basi canoniche di  e

e  rispettivamente, si ha:

rispettivamente, si ha:

L’applicazione lineare  è quindi rappresentata nelle basi canoniche da una matrice

è quindi rappresentata nelle basi canoniche da una matrice  , detta matrice jacobiana

, detta matrice jacobiana  di

di  in

in  .Il

.Il  -esimo vettore colonna della matrice jacobiana è dato dalla precedente relazione, e si ha:[5]

-esimo vettore colonna della matrice jacobiana è dato dalla precedente relazione, e si ha:[5]

![{\displaystyle \mathbf {L} (\mathbf {x} )\mathbf {h} =\sum _{i=1}^{m}\left[\sum _{j=1}^{n}{\frac {\partial F_{i}(\mathbf {x} )}{\partial x_{j))}h_{j}\right]\mathbf {u} _{i}=J_{F}\mathbf {h} ={\begin{bmatrix}{\dfrac {\partial F_{1)){\partial x_{1))}&\cdots &{\dfrac {\partial F_{1)){\partial x_{n))}\\\vdots &\ddots &\vdots \\{\dfrac {\partial F_{m)){\partial x_{1))}&\cdots &{\dfrac {\partial F_{m)){\partial x_{n))}\end{bmatrix))\mathbf {h} .}](https://wikimedia.org/api/rest_v1/media/math/render/svg/01ffca52ee4784256614c1f820250156691ef260)

A seconda delle dimensioni  e

e  , il jacobiano ha diverse interpretazioni geometriche:

, il jacobiano ha diverse interpretazioni geometriche:

- Se

, la matrice jacobiana si riduce ad un vettore

, la matrice jacobiana si riduce ad un vettore  -dimensionale, chiamato gradiente di

-dimensionale, chiamato gradiente di  in

in  . In tal caso si ha:

. In tal caso si ha:

- Il gradiente indica la direzione di “massima pendenza” del grafico della funzione nel punto.

- Se

, la funzione

, la funzione  parametrizza una curva in

parametrizza una curva in  , il suo differenziale è una funzione che definisce la direzione della retta tangente alla curva nel punto.

, il suo differenziale è una funzione che definisce la direzione della retta tangente alla curva nel punto.

- Se

, la condizione di differenziabilità coincide con la condizione di derivabilità.

, la condizione di differenziabilità coincide con la condizione di derivabilità.

- La matrice jacobiana si riduce ad un numero, pari alla derivata.

Differenziabilità in analisi complessaSia  un sottoinsieme aperto del piano complesso

un sottoinsieme aperto del piano complesso  . Una funzione

. Una funzione  è differenziabile in senso complesso (

è differenziabile in senso complesso ( -differenziabile) in un punto

-differenziabile) in un punto  di

di  se esiste il limite:

se esiste il limite:

Il limite va inteso in relazione alla topologia del piano. In altre parole, per ogni successione di numeri complessi che convergono a  il rapporto incrementale deve tendere allo stesso numero, indicato con

il rapporto incrementale deve tendere allo stesso numero, indicato con  . Se

. Se  è differenziabile in senso complesso in ogni punto

è differenziabile in senso complesso in ogni punto  di

di  , essa è una funzione olomorfa su

, essa è una funzione olomorfa su  . Si dice inoltre che

. Si dice inoltre che  è olomorfa nel punto

è olomorfa nel punto  se è olomorfa in qualche intorno del punto, e che

se è olomorfa in qualche intorno del punto, e che  è olomorfa in un insieme non aperto

è olomorfa in un insieme non aperto  se è olomorfa in un aperto contenente

se è olomorfa in un aperto contenente  .

.

La relazione tra la differenziabilità di funzioni reali e funzioni complesse è data dal fatto che se una funzione complessa  è olomorfa allora

è olomorfa allora  e

e  possiedono derivata parziale prima rispetto a

possiedono derivata parziale prima rispetto a  e

e  e soddisfano le equazioni di Cauchy-Riemann:

e soddisfano le equazioni di Cauchy-Riemann:

In modo equivalente, la derivata di Wirtinger  di

di  rispetto al complesso coniugato

rispetto al complesso coniugato  di

di  è nulla.

è nulla.

Proprietà delle funzioni differenziabili

- Una funzione differenziabile in un punto

è continua in

è continua in  . Infatti:

. Infatti:

-

- per la definizione data di funzione differenziabile e per la continuità delle funzioni lineari.

- Se

è una funzione differenziabile in

è una funzione differenziabile in  , allora essa ammette tutte le derivate parziali in

, allora essa ammette tutte le derivate parziali in  . Viceversa non è sempre vero che l’esistenza delle derivate parziali in un punto garantisca anche la differenziabilità nel punto. Ad esempio, la funzione reale di due variabili reali:

. Viceversa non è sempre vero che l’esistenza delle derivate parziali in un punto garantisca anche la differenziabilità nel punto. Ad esempio, la funzione reale di due variabili reali:

-

- ammette derivate parziali ovunque, ma il fatto che in

la funzione non sia continua impedisce la sua differenziabilità in

la funzione non sia continua impedisce la sua differenziabilità in  .

.

- Tuttavia, se

è di classe

è di classe  in un intorno di

in un intorno di  , cioè se esistono tutte le derivate parziali di

, cioè se esistono tutte le derivate parziali di  e queste sono funzioni continue, allora

e queste sono funzioni continue, allora  è differenziabile in

è differenziabile in  . Vale quindi, se

. Vale quindi, se  è aperto, che

è aperto, che  implica la differenziabilità in

implica la differenziabilità in  che implica a sua volta che

che implica a sua volta che  .

.

ApprossimazioniDa un punto di vista informale, una funzione differenziabile è una funzione tale da apparire sempre più simile ad una trasformazione affine quando viene vista ad ingrandimenti sempre maggiori. La trasformazione affine che approssima  in un intorno di

in un intorno di  è la funzione:

è la funzione:

.

.

Per verificarlo, si consideri un intorno di  di raggio

di raggio  .

.

Se si effettua uno zoom sul grafico di  in modo che l’intorno ci appaia di raggio

in modo che l’intorno ci appaia di raggio  , la distanza che si vede tra la funzione

, la distanza che si vede tra la funzione  e la funzione affine che la approssima in corrispondenza del punto

e la funzione affine che la approssima in corrispondenza del punto  è pari a:

è pari a:

dove la divisione per  corrisponde al riscalamento dovuto allo “zoom” che si sta operando sull’intorno. Quindi la massima distanza che si vede nell’intorno riscalato è:

corrisponde al riscalamento dovuto allo “zoom” che si sta operando sull’intorno. Quindi la massima distanza che si vede nell’intorno riscalato è:

,

,

ora si può dimostrare che dalla definizione di differenziabilità di  si deduce che:

si deduce che:

,

,

il che significa che quello che si osserva ingrandendo progressivamente il grafico di  e della sua approssimazione affine intorno a

e della sua approssimazione affine intorno a  è che questi tendono a coincidere. Viceversa, la relazione implica direttamente la differenziabilità di

è che questi tendono a coincidere. Viceversa, la relazione implica direttamente la differenziabilità di  .

.

°°°°°

Funzione liscia

In matematica, una funzione liscia in un punto del suo dominio è una funzione che è differenziabile infinite volte nel punto, o equivalentemente, che è derivabile infinite volte nel punto rispetto ad ogni sua variabile (per il teorema del differenziale infatti, una funzione è differenziabile in un punto se le sue derivate parziali sono ivi continue). Se una funzione  è liscia in tutti i punti di un insieme

è liscia in tutti i punti di un insieme  , si dice che essa è di classe

, si dice che essa è di classe  su

su  , e si scrive

, e si scrive  .

.

Funzioni lisce e funzioni analitiche nel caso reale

Sia  una funzione reale di variabile reale definita su un dominio

una funzione reale di variabile reale definita su un dominio  , e si supponga che

, e si supponga che  sia liscia sull’intervallo aperto

sia liscia sull’intervallo aperto  . Preso allora un punto

. Preso allora un punto  , è possibile approssimare la funzione attorno a quel punto grazie al teorema di Taylor:

, è possibile approssimare la funzione attorno a quel punto grazie al teorema di Taylor:

dove la quantità  è un resto tale che:

è un resto tale che:

Poiché la funzione è liscia, questa approssimazione vale per ogni  . In particolare, è possibile valutare la serie di Taylor della funzione prendendo il limite per

. In particolare, è possibile valutare la serie di Taylor della funzione prendendo il limite per  :

:

A differenza di quanto ci si potrebbe aspettare, questa serie in generale non converge a  : se la convergenza (puntuale) è verificata, si dice che

: se la convergenza (puntuale) è verificata, si dice che  è analitica in

è analitica in  , e se

, e se  è l’insieme dei punti in cui

è l’insieme dei punti in cui  è analitica si scrive

è analitica si scrive  . Poiché ogni funzione analitica è in particolare liscia, vale la relazione insiemistica:

. Poiché ogni funzione analitica è in particolare liscia, vale la relazione insiemistica:

Un discorso analogo può essere fatto per le funzioni a più variabili reali.

Funzioni lisce complesse

Nel caso di funzioni complesse di variabile complessa, la liscezza in un punto (o su un insieme) discende direttamente dall’olomorfia della funzione in tale punto (o su tale insieme). Per tale motivo si parla indifferentemente di “liscezza” o di “derivabilità” di una funzione complessa. In effetti, è possibile dimostrare che una funzione complessa olomorfa su un dominio è ivi addirittura analitica (vedi Equazioni di Cauchy-Riemann).

Definizione per le varietà differenziabili

Siano  e

e  varietà differenziabili e

varietà differenziabili e  un punto di

un punto di  . Una funzione

. Una funzione  è detta differenziabile in

è detta differenziabile in  (oppure liscia o di classe

(oppure liscia o di classe  in

in  ) se esistono una carta

) se esistono una carta  in

in  ed una carta

ed una carta  in

in  tali che

tali che  e la composizione:

e la composizione:

sia liscia in un intorno di  . Tale definizione non dipende dalle carte scelte: prendendo infatti altre carte

. Tale definizione non dipende dalle carte scelte: prendendo infatti altre carte  e

e  la composizione

la composizione  rimane liscia in un intorno di

rimane liscia in un intorno di  .

.

è differenziabile (liscia, di classe

è differenziabile (liscia, di classe  ) se lo è per ogni

) se lo è per ogni  in

in  . Se inoltre

. Se inoltre  è invertibile con inversa liscia allora

è invertibile con inversa liscia allora  si dirà un diffeomorfismo. Lo studio delle proprietà invarianti per diffeomorfismi è oggetto della topologia differenziale.

si dirà un diffeomorfismo. Lo studio delle proprietà invarianti per diffeomorfismi è oggetto della topologia differenziale.

Costruire funzioni lisce tramite restrizioni

È spesso utile costruire funzioni lisce che sono nulle al di fuori di un dato intervallo, ma non all’interno dello stesso (funzioni a supporto compatto). Tale proprietà non si può mai avere per una serie di potenze[1], il che fornisce un’ulteriore dimostrazione del divario tra le funzioni lisce e funzioni analitiche.

°°°°°

Funzione analitica

In matematica, una funzione analitica è una funzione localmente espressa da una serie di potenze convergente. Spesso il termine “funzione analitica” è utilizzato come sinonimo di funzione olomorfa, sebbene quest’ultimo si utilizzi più spesso per le funzioni complesse (tutte le funzioni olomorfe sono funzioni analitiche complesse e viceversa).[1] Una funzione è analitica se e solo se, preso comunque un punto appartenente al dominio della funzione, esiste un suo intorno in cui la funzione coincide col suo sviluppo in serie di Taylor.

Le funzioni analitiche possono essere viste come un ponte fra i polinomi e le funzioni generiche. Esistono le funzioni analitiche reali e le funzioni analitiche complesse: simili in alcuni aspetti, differenti in altri. Funzioni di questo tipo sono infinitamente derivabili, ma le funzioni analitiche complesse esibiscono proprietà che generalmente non appartengono alle funzioni analitiche reali.

DefinizioneUna funzione  è analitica su un insieme aperto

è analitica su un insieme aperto  della retta reale se per ogni

della retta reale se per ogni  in

in  si può scrivere

si può scrivere  come:[2]

come:[2]

dove i coefficienti  sono numeri reali e la serie è convergente in un intorno di

sono numeri reali e la serie è convergente in un intorno di  .

.

In alternativa, una funzione analitica è una funzione infinitamente derivabile, ossia una funzione liscia, tale che la sua serie di Taylor

in ogni punto  appartenente al dominio, converge a

appartenente al dominio, converge a  per

per  in un intorno di

in un intorno di  .

.

L’insieme di tutte le funzioni analitiche reali appartenenti ad un dato insieme  si denota di solito come

si denota di solito come  .

.

Una funzione  definita in un qualche sottoinsieme della retta reale, si dice essere reale analitica al punto

definita in un qualche sottoinsieme della retta reale, si dice essere reale analitica al punto  se esiste un intorno

se esiste un intorno  di

di  nel quale

nel quale  è reale analitica.

è reale analitica.

La definizione di funzione analitica complessa è ottenuta sostituendo dappertutto “reale” con “complesso.

Proprietà delle funzioni analiticheTra le principali proprietà che caratterizzano le funzioni analitiche ci sono le seguenti:

- La somma, il prodotto e la composizione di funzioni analitiche sono analitiche.

- Il reciproco di una funzione analitica che non si annulla mai, è analitico, così come l’inversa di una funzione analitica invertibile la cui derivata non è mai nulla.

- Tutti i polinomi sono funzioni analitiche. Per un polinomio, l’espansione in serie di potenze contiene solo un numero finito di termini non nulli.

- Tutte le funzioni analitiche sono lisce.

Un polinomio non può valere zero in troppi punti a meno che non sia il polinomio nullo (più precisamente, il numero di zeri è al massimo pari al grado del polinomio). Un’affermazione simile ma più debole vale per le funzioni analitiche. Se l’insieme degli zeri di una funzione analitica  ha un punto di accumulazione all’interno del suo dominio, allora

ha un punto di accumulazione all’interno del suo dominio, allora  è nulla su tutta la componente connessa del dominio che contiene il punto di accumulazione.

è nulla su tutta la componente connessa del dominio che contiene il punto di accumulazione.

Più formalmente questa affermazione può essere espressa nel modo seguente. Se  è una successione di numeri distinti tale che

è una successione di numeri distinti tale che  per ogni

per ogni  e questa successione converge a un punto

e questa successione converge a un punto  nel dominio

nel dominio  , allora

, allora  è identicamente zero nella componente connessa di

è identicamente zero nella componente connessa di  contenente

contenente  . Inoltre, se tutte le derivate di una funzione analitica sono nulle in un punto, vale ancora la conclusione precedente.

. Inoltre, se tutte le derivate di una funzione analitica sono nulle in un punto, vale ancora la conclusione precedente.

Queste affermazioni implicano che le funzioni analitiche siano ancora abbastanza rigide, nonostante il loro maggior numero di gradi di libertà rispetto ai polinomi.

Analiticità e derivabilità

Tutte le funzioni analitiche (reali o complesse) in un punto  sono infinitamente derivabili in

sono infinitamente derivabili in  , dove

, dove  è il raggio di convergenza della serie. Inoltre, si dimostra che nella stessa regione la derivata della funzione coincide con la serie delle derivate (la serie derivata), ovvero se:

è il raggio di convergenza della serie. Inoltre, si dimostra che nella stessa regione la derivata della funzione coincide con la serie delle derivate (la serie derivata), ovvero se:

allora:

Allo stesso modo, essendo il limite uniforme di una successione di funzioni continue (polinomi), ogni funzione analitica è continua (e quindi integrabile) su tutto il suo insieme di convergenza, e la sua primitiva è la serie primitiva. In altre parole, se:

si ha:

Non tutte le funzioni reali lisce sono analitiche; ad esempio la funzione definita come:

è liscia in  ma non è analitica in 0. Questo può essere espresso dall’implicazione (non invertibile):

ma non è analitica in 0. Questo può essere espresso dall’implicazione (non invertibile):

.

.

La situazione è molto diversa nel caso delle funzioni analitiche complesse. Si può dimostrare che tutte le funzioni olomorfe su un insieme aperto sono analitiche. Di conseguenza, in analisi complessa, il termine “funzione analitica” è un sinonimo di funzione olomorfa.

Condizione sufficiente

Se una funzione reale di variabile reale liscia definita su un aperto ha tutte le derivate maggiorabili dai termini di una successione geometrica (di ragione fissata) su un intorno di un dato punto, allora la funzione è analitica in quell’intorno. Formalmente, sia  ed appartenente a

ed appartenente a  e sia

e sia  . Se esistono

. Se esistono  tali che:

tali che:

allora:

In particolare, se una funzione ha tutte le derivate limitate da una stessa costante  su un intervallo, allora è ivi analitica (basta porre

su un intervallo, allora è ivi analitica (basta porre  nell’enunciato precedente). Questo mostra che funzioni come seno, coseno, esponenziale[3], funzioni iperboliche possono essere espresse in termini di serie di potenze sull’intero asse reale:

nell’enunciato precedente). Questo mostra che funzioni come seno, coseno, esponenziale[3], funzioni iperboliche possono essere espresse in termini di serie di potenze sull’intero asse reale:

Dimostrazione

Dato che la funzione  è liscia, è possibile scriverne la formula di Taylor arrestata all’ordine

è liscia, è possibile scriverne la formula di Taylor arrestata all’ordine  (resto secondo Lagrange):

(resto secondo Lagrange):

Se  si muove nell’intorno di

si muove nell’intorno di  di raggio

di raggio  si può usare la maggiorazione (in valore assoluto) garantita dall’ipotesi:

si può usare la maggiorazione (in valore assoluto) garantita dall’ipotesi:

cioè la serie converge puntualmente a  sull’intervallo

sull’intervallo  , Q.E.D.

, Q.E.D.

Funzioni analitiche in più variabili

Si possono definire le funzioni analitiche in più variabili tramite le serie di potenze in queste variabili. Le funzioni analitiche in più variabili hanno alcune delle proprietà delle funzioni analitiche a una variabile. Comunque, soprattutto nel caso delle funzioni analitiche complesse, si trovano nuovi e interessanti fenomeni in più dimensioni.

°°°°°

Funzione olomorfa

In matematica, una funzione olomorfa (composizione delle parole greche “holos”, tutto e “morphos“, forma; in riferimento alla capacità della derivata di rimanere uguale a sé stessa nelle trasformazioni[1]) è una funzione definita su un sottoinsieme aperto del piano dei numeri complessi  con valori in

con valori in  che è differenziabile in senso complesso in ogni punto del dominio. Le funzioni olomorfe sono tra gli oggetti principali dell’analisi complessa. Possono essere scritte ovunque come serie di potenze convergenti ovvero sono analitiche, ed il termine “funzione analitica” è utilizzato come sinonimo di funzione olomorfa.[2]

che è differenziabile in senso complesso in ogni punto del dominio. Le funzioni olomorfe sono tra gli oggetti principali dell’analisi complessa. Possono essere scritte ovunque come serie di potenze convergenti ovvero sono analitiche, ed il termine “funzione analitica” è utilizzato come sinonimo di funzione olomorfa.[2]

La differenziabilità in senso complesso di una funzione complessa è una condizione molto più stringente della differenziabilità reale in quanto implica che la funzione sia infinite volte differenziabile e che possa essere completamente individuata dalla sua serie di Taylor. In alcuni testi le funzioni olomorfe (e le loro derivate) definite su un aperto sono dette funzioni analitiche.

In tale contesto si definisce biolomorfismo fra due insiemi aperti di  una funzione olomorfa che sia iniettiva, suriettiva, e la cui inversa è anch’essa olomorfa.

una funzione olomorfa che sia iniettiva, suriettiva, e la cui inversa è anch’essa olomorfa.

Definizione

Sia  un sottoinsieme aperto del piano complesso

un sottoinsieme aperto del piano complesso  . Una funzione

. Una funzione  è differenziabile in senso complesso (

è differenziabile in senso complesso ( -differenziabile) in un punto

-differenziabile) in un punto  di

di  se esiste il limite:[3]

se esiste il limite:[3]

Il limite va inteso in relazione alla topologia del piano. In altre parole, per ogni successione di numeri complessi che convergono a  il rapporto incrementale deve tendere allo stesso numero, indicato con

il rapporto incrementale deve tendere allo stesso numero, indicato con  .

.

La funzione  è olomorfa in

è olomorfa in  se è differenziabile in senso complesso in ogni punto

se è differenziabile in senso complesso in ogni punto  dell’aperto

dell’aperto  . Si dice inoltre che

. Si dice inoltre che  è olomorfa nel punto

è olomorfa nel punto  se è olomorfa in qualche intorno del punto e più in generale che

se è olomorfa in qualche intorno del punto e più in generale che  è olomorfa in un insieme non aperto

è olomorfa in un insieme non aperto  se è olomorfa in un aperto contenente

se è olomorfa in un aperto contenente  .

.

Equazioni di Cauchy-Riemann

La relazione tra la differenziabilità di funzioni reali e funzioni complesse è data dal fatto che se una funzione complessa

è olomorfa allora  e

e  possiedono derivate parziali prime rispetto a

possiedono derivate parziali prime rispetto a  e

e  , e tali derivate soddisfano le equazioni di Cauchy-Riemann:

, e tali derivate soddisfano le equazioni di Cauchy-Riemann:

In modo equivalente, la derivata di Wirtinger  di

di  rispetto al complesso coniugato

rispetto al complesso coniugato  di

di  è nulla.

è nulla.

Proprietà di baseRelazione con la differenziabilità

Tramite l’identificazione standard di  con

con  , una funzione olomorfa è in particolare una funzione differenziabile da un aperto di

, una funzione olomorfa è in particolare una funzione differenziabile da un aperto di  in

in  . Non è però vero l’opposto: una funzione differenziabile non è necessariamente olomorfa. Le equazioni di Cauchy-Riemann descrivono una condizione necessaria e sufficiente affinché una funzione differenziabile sia olomorfa.

. Non è però vero l’opposto: una funzione differenziabile non è necessariamente olomorfa. Le equazioni di Cauchy-Riemann descrivono una condizione necessaria e sufficiente affinché una funzione differenziabile sia olomorfa.

Operazioni

Le usuali regole di derivazione definite solitamente in ambito reale restano valide nel campo complesso.[3]

Mappa conforme

Lo stesso argomento in dettaglio:

Mappa conforme e Immagini conformi.

Una funzione olomorfa avente derivata sempre diversa da zero è una mappa conforme, una mappa che non cambia gli angoli (ma può cambiare aree e lunghezze).

Infatti una funzione olomorfa con derivata non nulla è una funzione localmente approssimabile da una funzione lineare complessa del tipo

-

per qualche numero complesso  . Le mappe lineari di questo tipo sono conformi; infatti, scrivendo

. Le mappe lineari di questo tipo sono conformi; infatti, scrivendo  , si ottiene

, si ottiene

-

e quindi la moltiplicazione per  è geometricamente la composizione di una rotazione di angolo

è geometricamente la composizione di una rotazione di angolo  e di una omotetia di fattore

e di una omotetia di fattore  : entrambe queste operazioni sono mappe conformi.

: entrambe queste operazioni sono mappe conformi.

Esempi Funzioni intere

Lo stesso argomento in dettaglio:

Funzioni intere.Tutte le funzioni polinomiali nella variabile complessa  con coefficienti complessi sono olomorfe sull’intero

con coefficienti complessi sono olomorfe sull’intero  , cioè sono funzioni intere.

, cioè sono funzioni intere.

Sono funzioni intere anche la funzione esponenziale complessa e le funzioni trigonometriche nella  . (In effetti le funzioni trigonometriche sono esprimibili come composizioni di varianti della funzione esponenziale attraverso la formula di Eulero).

. (In effetti le funzioni trigonometriche sono esprimibili come composizioni di varianti della funzione esponenziale attraverso la formula di Eulero).

Funzioni non intere

La funzione  è olomorfa sul piano complesso privato dell’origine:

è olomorfa sul piano complesso privato dell’origine:

Il ramo principale della funzione logaritmo  è olomorfo sul piano complesso privato del semiasse reale negativo:

è olomorfo sul piano complesso privato del semiasse reale negativo:

La funzione radice quadrata può essere definita come

e di conseguenza è olomorfa in tutti i punti del piano complesso nei quali lo è la funzione logaritmo.

Funzioni non olomorfeGli esempi base di funzioni complesse non olomorfe sono la coniugazione complessa, il passaggio alla parte reale e la funzione valore assoluto.

Lo stesso argomento in dettaglio:

Teorema di Liouville (analisi complessa).

Il teorema di Liouville asserisce che se una funzione intera ha modulo limitato su tutto il piano complesso allora è costante.

Funzioni olomorfe in più variabiliUna funzione complessa di più variabili è una funzione del tipo

definita su un aperto  di

di  . Questa è olomorfa in un punto se è localmente sviluppabile (all’interno di un polidisco, cioè all’interno di un prodotto cartesiano di dischi centrato nel punto) come serie di potenze convergente. Si osserva che questa condizione è più forte delle equazioni di Cauchy-Riemann; in effetti essa può essere espressa nella forma seguente:

. Questa è olomorfa in un punto se è localmente sviluppabile (all’interno di un polidisco, cioè all’interno di un prodotto cartesiano di dischi centrato nel punto) come serie di potenze convergente. Si osserva che questa condizione è più forte delle equazioni di Cauchy-Riemann; in effetti essa può essere espressa nella forma seguente:

Una funzione di più variabili complesse a valori complessi è olomorfa se e solo se soddisfa le equazioni di Cauchy-Riemann ed è localmente a quadrato sommabile.

Esempi

-

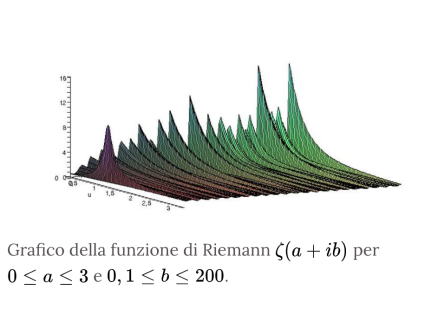

- è meromorfa sull’intero piano complesso.

-

- come pure la funzione gamma e la funzione zeta di Riemann, sono meromorfe sull’intero piano complesso.

-

- è definita sull’intero piano complesso ad esclusione dell’origine. Il punto 0, tuttavia, non è un polo della funzione, ma una sua singolarità essenziale. Quindi essa non è meromorfa sull’intero piano complesso; essa è invece meromorfa (e in particolare olomorfa) sul cosiddetto piano complesso forato nell’origine

.

.

Cenni storici

L’idea di base del concetto di integrale era nota ad Archimede di Siracusa, vissuto tra il 287 e il 212 a.C., ed era contenuta nel metodo da lui usato per il calcolo dell’area del cerchio o dell’area sottesa al segmento di un ramo di parabola, detto metodo di esaustione, già proposta da Eudosso di Cnido.

Qual è l’integrale (animazione)

La definizione di integrale per le funzioni continue in un intervallo venne inizialmente formulata da Augustin-Louis Cauchy, che a partire dal lavoro di Mengoli, descrisse l’integrale utilizzando la definizione di limite.

In seguito Bernhard Riemann propose la sua definizione, in modo da comprendere classi più estese di funzioni. Nel 1875, Gaston Darboux riformulò la definizione già individuata da Cauchy in modo da evitare l’uso di limiti e dimostrando che era del tutto equivalente alla definizione data da Riemann.

Per questo motivo spesso si parla di integrale di Riemann-Darboux. Allo scopo di comprendere una classe molto più estesa di funzioni, Henri Lebesgue produsse una definizione di integrale più complessa, attraverso l’introduzione della teoria della misura.

In seguito Thomas Stieltjes fu in grado di generalizzare l’integrale di Riemann introducendo il concetto di funzione integratrice e, con un procedimento del tutto analogo, Johann Radon generalizzò l’integrale di Lebesgue.

Una definizione d’integrale alternativa a quella di Lebesgue-Radon venne fornita da Percy J. Daniell, che la ricavò a partire dall’integrale di Riemann-Stieltjes.

Introduzione euristica

Si consideri una funzione  reale di variabile reale limitata e definita su un intervallo

reale di variabile reale limitata e definita su un intervallo ![[a,b]](https://wikimedia.org/api/rest_v1/media/math/render/svg/9c4b788fc5c637e26ee98b45f89a5c08c85f7935) sull’asse delle ascisse.

sull’asse delle ascisse.

Quando si procede a calcolare l’integrale di  su

su ![[a,b]](https://wikimedia.org/api/rest_v1/media/math/render/svg/9c4b788fc5c637e26ee98b45f89a5c08c85f7935) , allora

, allora  è detta funzione integranda e l’intervallo

è detta funzione integranda e l’intervallo ![[a,b]](https://wikimedia.org/api/rest_v1/media/math/render/svg/9c4b788fc5c637e26ee98b45f89a5c08c85f7935) è detto intervallo di integrazione e gli estremi

è detto intervallo di integrazione e gli estremi  e

e  sono detti estremi di integrazione.

sono detti estremi di integrazione.

La figura che ha per bordi il grafico di  , l’asse delle ascisse e i segmenti verticali condotti dagli estremi dell’intervallo di integrazione agli estremi del grafico della funzione è detta trapezoide.

, l’asse delle ascisse e i segmenti verticali condotti dagli estremi dell’intervallo di integrazione agli estremi del grafico della funzione è detta trapezoide.

Il valore dell’integrale della funzione calcolato sull’intervallo di integrazione è uguale all’area (con segno) del trapezoide, cioè il numero reale che esprime tale area orientata viene chiamato integrale (definito) della funzione esteso all’intervallo di integrazione.

Con il termine “integrale” o “operatore integrale” si indica anche l’operazione stessa che associa il valore dell’area orientata alla funzione.

Sono stati ideati diversi modi per definire in modo rigoroso l’integrale; a seconda della procedura adottata cambia anche l’insieme delle funzioni che è possibile misurare con un integrale.

Un metodo è quello di “approssimare” il grafico della funzione con una linea costituita da uno o più segmenti, in modo che la figura si può scomporre in uno o più trapezi di cui è facile calcolare l’area: la somma algebrica delle aree di tutti i trapezi è allora l’integrale cercato.

Un tale approccio è utilizzato per definire l’integrale di Riemann, in cui il calcolo dell’area viene eseguito suddividendo la figura in sottili strisce verticali ottenendo così dei rettangoli. Nello specifico, dividendo un intervallo di integrazione ![[a,b]](https://wikimedia.org/api/rest_v1/media/math/render/svg/9c4b788fc5c637e26ee98b45f89a5c08c85f7935) in

in  intervalli del tipo

intervalli del tipo ![{\displaystyle [x_{k-1},x_{k}]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f77539e232b976d1a83e1829624235bba4164757) , per

, per  , e con

, e con  e

e  , per ciascun intervallo si può considerare un punto

, per ciascun intervallo si può considerare un punto  la cui immagine è

la cui immagine è  . Si costruisce allora il rettangolo che ha per base l’intervallo

. Si costruisce allora il rettangolo che ha per base l’intervallo ![{\displaystyle [x_{k-1},x_{k}]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f77539e232b976d1a83e1829624235bba4164757) e per altezza

e per altezza  .

.

La figura costituita da tutti i rettangoli così costruiti è detta plurirettangolo e l’area del plurirettangolo è detta somma integrale di Cauchy o somma integrale di Riemann-Darboux:

Se al diminuire dell’ampiezza degli intervalli  i valori così ottenuti si concentrano in un intorno sempre più piccolo di un numero

i valori così ottenuti si concentrano in un intorno sempre più piccolo di un numero  , la funzione

, la funzione  è integrabile sull’intervallo

è integrabile sull’intervallo ![[a,b]](https://wikimedia.org/api/rest_v1/media/math/render/svg/9c4b788fc5c637e26ee98b45f89a5c08c85f7935) e

e  è il valore del suo integrale.

è il valore del suo integrale.

Se la funzione integrabile  è positiva allora l’integrale assume il significato di area della regione:

è positiva allora l’integrale assume il significato di area della regione:

-

![{\displaystyle {\mathcal {R))=\{(x,y)\in \mathbb {R} ^{2},\,0\leq y\leq f(x),x\in [a,b]\}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/bddcd6038f92f9c2bd61b881764bc2efcc234f3a)

Se la funzione  cambia segno su

cambia segno su ![[a,b]](https://wikimedia.org/api/rest_v1/media/math/render/svg/9c4b788fc5c637e26ee98b45f89a5c08c85f7935) allora l’integrale rappresenta una somma di aree con segno diverso.

allora l’integrale rappresenta una somma di aree con segno diverso.

Definizione

La prima definizione rigorosa a essere stata formulata di integrale di una funzione su un intervallo è l’integrale di Riemann, formulato da Bernhard Riemann, anche se per definirlo si preferisce utilizzare la formulazione data da Gaston Darboux.

L’integrale di Lebesgue consente di integrare una più vasta classe di funzioni rispetto all’integrale di Riemann.

Per mostrare la relazione tra i due integrali è necessario utilizzare la classe delle funzioni continue a supporto compatto, per le quali l’integrale di Riemann esiste sempre.

Siano  e

e  due funzioni continue a supporto compatto su

due funzioni continue a supporto compatto su  .

.

Si può definire la loro distanza nel seguente modo:

Munito della funzione distanza, lo spazio delle funzioni continue a supporto compatto è uno spazio metrico.

Il completamento di tale spazio metrico è l’insieme delle funzioni integrabili secondo Lebesgue.

In letteratura esistono diversi altri operatori di integrazione, tuttavia essi godono di minore diffusione rispetto a quelli di Riemann e Lebesgue.

Integrale di Riemann-Darboux

Lo stesso argomento in dettaglio:

Integrale di Riemann e Integrale di Darboux.

Sia ![PC[a,b]](https://wikimedia.org/api/rest_v1/media/math/render/svg/6b1be1f04552b49f5f59b0db31783c77138cd9b3) l’insieme delle funzioni limitate e continue a tratti sull’intervallo

l’insieme delle funzioni limitate e continue a tratti sull’intervallo ![[a,b]](https://wikimedia.org/api/rest_v1/media/math/render/svg/9c4b788fc5c637e26ee98b45f89a5c08c85f7935) , e tali da essere continue da destra:

, e tali da essere continue da destra:

-

La norma di tali funzioni può essere definita come:

-

![{\displaystyle \|f\|_{\infty }=\sup _{x\in [a,b]}|f(x)|.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/852a678d206c6870a134228daf5682284d82b09c)

Sia  una partizione di

una partizione di ![[a,b]](https://wikimedia.org/api/rest_v1/media/math/render/svg/9c4b788fc5c637e26ee98b45f89a5c08c85f7935) e

e  la funzione indicatrice dell’i-esimo intervallo della partizione

la funzione indicatrice dell’i-esimo intervallo della partizione ![[x_((i-1)),x_{i}]](https://wikimedia.org/api/rest_v1/media/math/render/svg/09cb12a889d47020c8ce7046a2eb60785e00c0b6) .

.

L’insieme ![S[a,b]](https://wikimedia.org/api/rest_v1/media/math/render/svg/ae911ae7a3fd00feb05a6d3c0cf0d78eec8bc712) delle possibili partizioni dell’intervallo

delle possibili partizioni dell’intervallo ![[a,b]](https://wikimedia.org/api/rest_v1/media/math/render/svg/9c4b788fc5c637e26ee98b45f89a5c08c85f7935) costituisce uno spazio vettoriale normato, con norma data da:

costituisce uno spazio vettoriale normato, con norma data da:

-

![{\displaystyle \|\sum _{i=1}^{n}c_{i}\chi _{i}(x)\|_{\infty }=\sup _{x\in [a,b]}|\sum _{i=1}^{n}c_{i}\chi _{i}(x)|=\max _{i=1,\dots ,n}|c_{i}|\qquad c_{i}\in \mathbb {R} .}](https://wikimedia.org/api/rest_v1/media/math/render/svg/72eb61e8909581681e61e24d8fc60ca0d6916c9b)

L’insieme ![S[a,b]](https://wikimedia.org/api/rest_v1/media/math/render/svg/ae911ae7a3fd00feb05a6d3c0cf0d78eec8bc712) è denso in

è denso in ![PC[a,b]](https://wikimedia.org/api/rest_v1/media/math/render/svg/6b1be1f04552b49f5f59b0db31783c77138cd9b3) . Si definisce la trasformazione lineare limitata

. Si definisce la trasformazione lineare limitata ![I:S[a,b]\to \mathbb{R}](https://wikimedia.org/api/rest_v1/media/math/render/svg/58944acc0fd1b885dd0f770e5de529e4160979de) nel seguente modo:

nel seguente modo:

![{\displaystyle I\left[\sum _{i=1}^{n}c_{i}\chi _{i}(x)\right]=\sum _{i=1}^{n}c_{i}(x_{i}-x_{i-1}).}](https://wikimedia.org/api/rest_v1/media/math/render/svg/dd1ec257063cce8eb410d4c1497458e1c5ccaec7)

Si dimostra che un operatore lineare limitato che mappa uno spazio vettoriale normato in uno spazio normato completo può essere sempre esteso in modo unico a un operatore lineare limitato che mappa il completamento dello spazio di partenza nel medesimo spazio di arrivo.

Poiché i numeri reali costituiscono un insieme completo, l’operatore  può quindi essere esteso a un operatore

può quindi essere esteso a un operatore  che mappa il completamento

che mappa il completamento ![{\hat S}[a,b]](https://wikimedia.org/api/rest_v1/media/math/render/svg/27dff51cb7580b01add1c586172814be7b49f9c3) di

di ![S[a,b]](https://wikimedia.org/api/rest_v1/media/math/render/svg/ae911ae7a3fd00feb05a6d3c0cf0d78eec8bc712) in

in  .

.

Si definisce integrale di Riemann-Darboux l’operatore ![{\displaystyle {\hat {I))\colon {\hat {S))[a,b]\to \mathbb {R} }](https://wikimedia.org/api/rest_v1/media/math/render/svg/27e1a973047691204b657c53d8caaa1a17712115) , e si indica con:

, e si indica con:

Integrale di Lebesgue

Sia  una misura su una sigma-algebra

una misura su una sigma-algebra  di sottoinsiemi di un insieme

di sottoinsiemi di un insieme  . Ad esempio,

. Ad esempio,  può essere un n-spazio euclideo

può essere un n-spazio euclideo  o un qualche suo sottoinsieme Lebesgue-misurabile,

o un qualche suo sottoinsieme Lebesgue-misurabile,  la sigma-algebra di tutti i sottoinsiemi Lebesgue-misurabili di

la sigma-algebra di tutti i sottoinsiemi Lebesgue-misurabili di  e

e  la misura di Lebesgue.

la misura di Lebesgue.

Nella teoria di Lebesgue gli integrali sono limitati a una classe di funzioni, chiamate funzioni misurabili. Una funzione  è misurabile se la controimmagine di ogni insieme aperto

è misurabile se la controimmagine di ogni insieme aperto  del codominio è in

del codominio è in  , ossia se

, ossia se  è un insieme misurabile di

è un insieme misurabile di  per ogni aperto

per ogni aperto  .

.

L’insieme delle funzioni misurabili è chiuso rispetto alle operazioni algebriche, e in particolare la classe è chiusa rispetto a vari tipi di limiti puntuali di successioni.

Allora:

-

L’integrale di Lebesgue di una funzione semplice è definito nel seguente modo:

Sia  una funzione misurabile non negativa su

una funzione misurabile non negativa su  a valori sulla retta reale estesa. L’integrale di Lebesgue di

a valori sulla retta reale estesa. L’integrale di Lebesgue di  sull’insieme

sull’insieme  rispetto alla misura

rispetto alla misura  è definito nel seguente modo:

è definito nel seguente modo:

dove l’estremo superiore è valutato considerando tutte le funzioni semplici  tali che

tali che  . Il valore dell’integrale è un numero nell’intervallo

. Il valore dell’integrale è un numero nell’intervallo ![[0,\infty ]](https://wikimedia.org/api/rest_v1/media/math/render/svg/52088d5605716e18068a460dec118214954a68e9) .

.

L’insieme delle funzioni tali che:

è detto insieme delle funzioni integrabili su  secondo Lebesgue rispetto alla misura

secondo Lebesgue rispetto alla misura  , o anche insieme delle funzioni sommabili, ed è denotato con

, o anche insieme delle funzioni sommabili, ed è denotato con  .

.

Anche l’integrale di Lebesgue è un funzionale lineare, e considerando una funzione definita su un intervallo  il teorema di Riesz permette di affermare che per ogni funzionale lineare

il teorema di Riesz permette di affermare che per ogni funzionale lineare  su

su  è associata una misura di Borel finita

è associata una misura di Borel finita  su

su  tale che:[9]

tale che:[9]

-

In questo modo il valore del funzionale dipende con continuità dalla lunghezza dell’intervallo di integrazione.

Integrale in più variabili

Lo stesso argomento in dettaglio:

Integrale multiplo.

Sia  un vettore nel campo reale. Un insieme del tipo:

un vettore nel campo reale. Un insieme del tipo:

-

è detto  -cella. Sia

-cella. Sia  definita su

definita su  una funzione continua a valori reali, e si definisca:

una funzione continua a valori reali, e si definisca:

-

Tale funzione è definita su  ed è a sua volta continua a causa della continuità di

ed è a sua volta continua a causa della continuità di  . Iterando il procedimento si ottiene una classe di funzioni

. Iterando il procedimento si ottiene una classe di funzioni  continue su

continue su  che sono il risultato dell’integrale di

che sono il risultato dell’integrale di  rispetto alla variabile

rispetto alla variabile  sull’intervallo

sull’intervallo ![[a_((j+1)),b_((j+1))]](https://wikimedia.org/api/rest_v1/media/math/render/svg/295494b4f541a3b833f797b4a7bf35648df67044) . Dopo

. Dopo  volte si ottiene il numero:

volte si ottiene il numero:

Si tratta dell’integrale di  su

su  rispetto a

rispetto a  , e non dipende dall’ordine con il quale vengono eseguite le

, e non dipende dall’ordine con il quale vengono eseguite le  integrazioni.

integrazioni.

In particolare, sia  . Allora si ha:

. Allora si ha:

Inoltre, sia  una funzione a supporto compatto e si ponga che

una funzione a supporto compatto e si ponga che  contenga il supporto di

contenga il supporto di  . Allora è possibile scrivere:

. Allora è possibile scrivere:

Nell’ambito della teoria dell’integrale di Lebesgue è possibile estendere questa definizione a insiemi di funzioni più ampi.

Una proprietà di notevole importanza dell’integrale di una funzione in più variabili è la seguente.

Siano:

Allora si ha:

L’integrando  ha un supporto compatto grazie all’invertibilità di

ha un supporto compatto grazie all’invertibilità di  , dovuta all’ipotesi

, dovuta all’ipotesi  per ogni

per ogni  che garantisce la continuità di

che garantisce la continuità di  in

in  per il teorema della funzione inversa.

per il teorema della funzione inversa.

Integrale curvilineo

Lo stesso argomento in dettaglio:

Integrale di linea e Integrale di superficie.

Dato un campo scalare  , si definisce l’integrale di linea (di prima specie) su una curva

, si definisce l’integrale di linea (di prima specie) su una curva  , parametrizzata da

, parametrizzata da  , con

, con ![t\in [a,b]](https://wikimedia.org/api/rest_v1/media/math/render/svg/b7f3050ace6dc0dd95250c418528da28eb477ffe) , come:[10]

, come:[10]

dove il termine  indica che l’integrale è effettuato su un’ascissa curvilinea. Se il dominio della funzione

indica che l’integrale è effettuato su un’ascissa curvilinea. Se il dominio della funzione  è

è  , l’integrale curvilineo si riduce al comune integrale di Riemann valutato nell’intervallo

, l’integrale curvilineo si riduce al comune integrale di Riemann valutato nell’intervallo ![[r(a),r(b)]](https://wikimedia.org/api/rest_v1/media/math/render/svg/0adcd6bce50edb796dfb92b2bc3782eab79a065c) . Alla famiglia degli integrali di linea appartengono anche gli integrali ellittici di prima e di seconda specie, questi ultimi impiegati anche in ambito statistico per il calcolo della lunghezza della curva di Lorenz.

. Alla famiglia degli integrali di linea appartengono anche gli integrali ellittici di prima e di seconda specie, questi ultimi impiegati anche in ambito statistico per il calcolo della lunghezza della curva di Lorenz.

Similmente, per un campo vettoriale  , l’integrale di linea (di seconda specie) lungo una curva

, l’integrale di linea (di seconda specie) lungo una curva  , parametrizzata da

, parametrizzata da  con

con ![t\in [a,b]](https://wikimedia.org/api/rest_v1/media/math/render/svg/b7f3050ace6dc0dd95250c418528da28eb477ffe) , è definito da:[11]

, è definito da:[11]

Continuità e integrabilità

Lo stesso argomento in dettaglio:

Funzione integrabile.

Una condizione sufficiente ai fini dell’integrabilità è che una funzione definita su un intervallo chiuso e limitato sia continua: una funzione continua definita su un compatto, e quindi continua uniformemente per il teorema di Heine-Cantor, è integrabile.

| Dimostrazione |

Si suddivida l’intervallo ![[a,b]](https://wikimedia.org/api/rest_v1/media/math/render/svg/9c4b788fc5c637e26ee98b45f89a5c08c85f7935) in in  sottointervalli sottointervalli ![{\displaystyle [x_{i-1},x_{i}]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/09cb12a889d47020c8ce7046a2eb60785e00c0b6) di uguale ampiezza: di uguale ampiezza:

Si scelga in ogni intervallo un punto  interno a interno a ![{\displaystyle [x_{i-1},x_{i}]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/09cb12a889d47020c8ce7046a2eb60785e00c0b6) e si definisce la somma integrale: e si definisce la somma integrale:

Ponendo  e e  il massimo e il minimo di il massimo e il minimo di  in ogni intervallo in ogni intervallo ![{\displaystyle [x_{i-1},x_{i}]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/09cb12a889d47020c8ce7046a2eb60785e00c0b6) si costruiscono quindi le somme: si costruiscono quindi le somme:

All’aumentare di  , si ha che , si ha che  diminuisce e diminuisce e  cresce. Essendo allora le due successioni monotone, esse ammettono un limite, il quale è finito. Sia ora: cresce. Essendo allora le due successioni monotone, esse ammettono un limite, il quale è finito. Sia ora:

Si ha che:

Per il teorema di esistenza del limite di successioni monotone risulta  e e  , con , con  . All’affinarsi della partizione di . All’affinarsi della partizione di ![[a,b]](https://wikimedia.org/api/rest_v1/media/math/render/svg/9c4b788fc5c637e26ee98b45f89a5c08c85f7935) risulta risulta  , infatti è possibile fissare un , infatti è possibile fissare un  piccolo a piacere e un numero di suddivisioni della partizione sufficientemente grande da far risultare: piccolo a piacere e un numero di suddivisioni della partizione sufficientemente grande da far risultare:

poiché per la continuità uniforme di  si ha: si ha:

Cioè, per un numero di  suddivisioni abbastanza elevato: suddivisioni abbastanza elevato:

Per il teorema del confronto delle successioni si ha:

ossia:

da cui, data l’arbitrarietà del fattore  , risulta che con il passaggio al limite la differenza tra le somme integrali massimante e minimante tende a zero. Da questo segue che: , risulta che con il passaggio al limite la differenza tra le somme integrali massimante e minimante tende a zero. Da questo segue che:

In definitiva, essendo:

per il teorema del confronto risulta  , da cui si deduce che se la funzione integranda è continua su un compatto , da cui si deduce che se la funzione integranda è continua su un compatto ![[a,b]](https://wikimedia.org/api/rest_v1/media/math/render/svg/9c4b788fc5c637e26ee98b45f89a5c08c85f7935) allora l’operazione di integrazione non dipende dalla scelta dei punti interni agli intervalli allora l’operazione di integrazione non dipende dalla scelta dei punti interni agli intervalli ![{\displaystyle [x_{i-1},x_{i}]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/09cb12a889d47020c8ce7046a2eb60785e00c0b6) , ovvero la funzione è integrabile. , ovvero la funzione è integrabile. |

Assoluta integrabilità

Una funzione  si dice assolutamente integrabile su un intervallo aperto del tipo

si dice assolutamente integrabile su un intervallo aperto del tipo  se su tale intervallo è integrabile

se su tale intervallo è integrabile  . Non tutte le funzioni integrabili sono assolutamente integrabili: un esempio di funzione di questo tipo è

. Non tutte le funzioni integrabili sono assolutamente integrabili: un esempio di funzione di questo tipo è  . Viceversa, il teorema sull’esistenza degli integrali impropri all’infinito garantisce che una funzione